——AIの答えがズレる本当の理由と、思考を設計するための5つのステップ

「AIが出してきた施策、論理的には正しいんだけど、なんか違うんだよな」

会議でそういう空気になったこと、ありませんか。発表した本人も自信なさげで、聞いている側も「??」という顔をしている。でも具体的に何がおかしいのか、うまく言語化できない。

私はマーケティングコンサルとして多くの現場を見てきましたが、AIが普及してからこの状況が明らかに増えています。そしてその原因は、AIの精度の問題ではありません。

AIに何かを聞く前に、自分たちが「何を達成したいのか」を決めていないことが問題です。

この記事では、AIの答えがズレる構造的な理由を整理した上で、思考を正しく設計するための5つのステップと、すぐに使える壁打ち用プロンプトを紹介します。

AIの答えがズレる、本当の理由

Mixpanelのブログ記事「Black-box AI: Does your AI analytics tool show its work?」は、AIが根拠を示さずに自信満々な推奨を出す「ブラックボックスAI」の問題を取り上げています。AIの出力を透明化するための6つのプロンプト手法を提示していて、方向性としては正しいと思います。

ただ、もっと手前に問題があります。

Mixpanelが指摘するのは「AIが根拠を示さない(ブラックボックス)」という問題です。しかし現場で起きているズレの本質は、その一歩手前にあります。AIがブラックボックスである以上に、人間側がホワイトボックスな情報——目標、文脈、制約、判断基準——をAIに渡せていないことが問題です。

入力が曖昧なら、出力も曖昧になる。これは当然の帰結です。

AIは「汎用解」しか出せません。あなたの会社の業界、顧客層、組織の事情、過去の施策の経緯、経営の優先順位——そういった固有の文脈を知らないまま答えを出します。だから論理的には正しくても、「自分たちには合わない」解が出てくる。

さらに深刻なのは、その答えを咀嚼せずにそのまま持ってくる、という使い方が広がっていることです。これはAIの限界ではなく、使い手側の問題です。

そしてその根本には、こういう状況があります。

目標も理想状態も曖昧なまま、「何かいい施策はないか」とAIに聞いている。

AIに何を聞くかより、自分が何を解きたいのかを先に決めることの方が、ずっと重要です。私はこれを確信しています。

思考の順番を設計する5つのステップ

AIを正しく使うとは、AIに「答えを出させる」ことではありません。自分の思考プロセスの中にAIを正しく組み込むことです。

その順番は、こう設計します。

【大前提】目標・理想状態を設定する

「そもそも何を達成したいのか」「達成した状態はどんな姿か」を言語化します。これがないと、問題の定義もズレるし、課題の優先順位もつけられない。AIの答えが合っているかどうかの判断基準すら持てません。すべての出発点です。

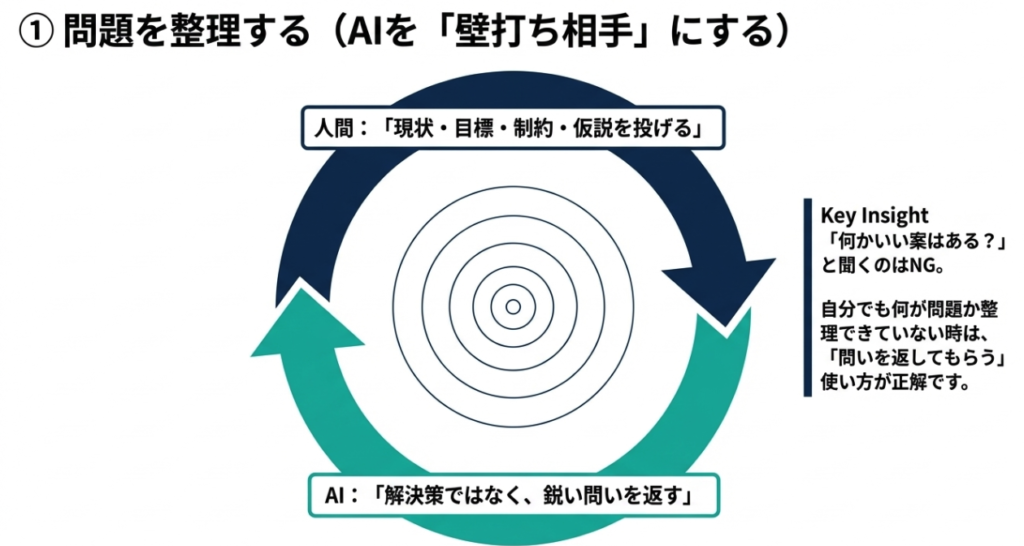

①問題を整理する——AIを「壁打ち相手」として使う

理想と現状のギャップを言語化します。ここはAIが強力に機能するステップです。「何が問題なのか」をまだ自分でも整理できていないとき、AIを壁打ち相手として使うのは非常に有効です。

ただし、「何かいい案はある?」と聞くのではなく、「問いを返してもらう」使い方が正解です。以下のプロンプトをそのまま使ってみてください。

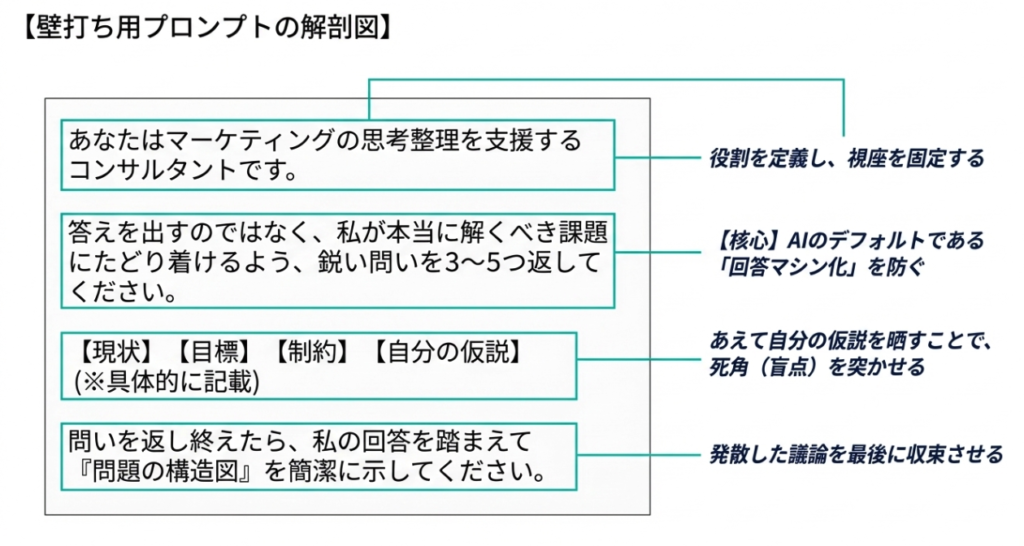

【壁打ち用プロンプト】

あなたはマーケティングの思考整理を支援するコンサルタントです。私が置かれている状況を伝えますので、答えを出すのではなく、私が「本当に解くべき課題」にたどり着けるよう、鋭い問いを3〜5つ返してください。

【現状】 (例:新規顧客獲得のためにSNS広告を強化しているが、CPAが改善しない)

【目標・理想状態】 (例:3ヶ月以内にCPAを20%改善し、月間新規獲得数を維持したい)

【制約】 (例:予算は現状維持、運用担当は1名、クリエイティブ制作は外注不可)

【自分の仮説】 (例:ターゲティングがズレているか、LPの離脱率が高いのではと思っている)

問いを返し終えたら、私の回答を踏まえて「問題の構造図」を簡潔に示してください。

このプロンプトの核心は「答えではなく問いを返せ」と明示している点です。AIはデフォルトで答えを出そうとするので、ここを指定しないと壁打ちではなく回答マシンになります。また、自分の仮説をあえて晒すことで、「その仮説の死角はどこか」を突いてもらえます。

②課題を設定する——ここは人間が主導する

問題の中から「何を解くべきか」を絞ります。ここは人間が主導しなければいけません。AIは汎用的な課題を出してきますが、自分たちの目標・制約・優先順位に照らして、どの課題に集中するかは自分で決める必要があります。

なぜAIに任せてはいけないのか。理由は2つあります。

ひとつは責任の問題です。AIは「もっともらしい選択」は提示できますが、「この課題を選んだ結果、うまくいかなかったときに責任を取る覚悟」は持てません。課題設定とは、リスクを引き受ける意思決定です。それは人間にしかできません。

もうひとつは文脈の希少性です。社内の力学、過去の失敗の経緯、経営陣が今何を気にしているか、チームのリソースの実態——こういった情報はAIには渡せないか、渡せたとしても表面的にしか伝わりません。課題の優先順位は、この「言語化しにくい文脈」の中にこそ埋まっています。

AIが出してきた課題候補を参考にしながらも、「これは自分たちの状況に本当に合っているか」を必ず問い直してください。

③仮説を立てる——AIと一緒に考えるが、絞り込みは人間が行う

「なぜそのギャップが生じているのか」を言語化します。課題が決まったら、仮説をAIと一緒に広げるのは有効です。ただし、複数の仮説が出てきたとき、どれが自分たちの状況に近いかはドメイン知識を持つ人間が判断します。AIが出した仮説をそのまま採用するのではなく、現場感覚と照らし合わせて絞り込む、という使い方が正解です。

④アクションを設計する——AIを素材出しに使い、判断は人間が行う

仮説を検証・解消するために何をするかを設計します。AIに選択肢や素材を出させながら、最終的な判断は人間が行います。このステップでもAIの出力をそのまま使わないことが原則です。

AIが強力に機能するのは①と④です。しかし②と③を飛ばして④の答えだけ持ってくるから、会議で「??」が起きます。

⑤実行・評価する

アクションを実行し、結果を評価します。評価の際もAIを使って分析することはできますが、「何を評価するか」の設計は人間が行います。大前提の目標・理想状態に立ち返って、ズレていないかを確認することが重要です。

AIの出力は必ず検証する

④のステップでAIを使うとき、出力をそのまま使わないことが原則です。検証の方法はデータの種類によって変わります。

手元にデータがある場合

自社のレポートやGA4のエクスポートデータなど、自分で正確性を確認できるデータをAIに渡して分析させます。入力データの正確性を自分でコントロールできるので、「データが間違っている」リスクを最小化できます。

データをAIに集めてもらう場合

競合調査や市場動向など、ディープリサーチ機能を使ってAIに情報収集させるケースです。この場合、AIが拾ってきた情報の正確性は保証されません。一次情報に当たって自分で検証するか、別のAIに同じテーマをリサーチさせて結果を比較することが有効です。

いずれのケースも共通するのは、「AIが出したデータをそのまま使わない」という姿勢です。

さらに精度を上げるには、以下の2つも有効です。

反論させるプロンプトを使う

同じAIに、自分が出した結論を攻撃させます。「この分析の弱点と、間違っている可能性が高いポイントを挙げて」「この結論に反対する立場で論じて」。AIは批判的に問われると別の角度から考えるため、盲点が見えやすくなります。

複数のAIで比較する

Claude・GPT-4・Geminiなど複数のAIに同じ質問を投げます。回答が一致する部分を信頼し、食い違う部分を疑う。一つのモデルの癖やバイアスに引っ張られるリスクを下げられます。

最後の砦は、ドメイン知識です

AIの正確性を完全に担保する方法はありません。これはAIの欠陥ではなく、確率的システムの本質的な性質です。だから問題は「どうやって担保するか」ではなく、「リスクを構造的に下げる使い方をどう設計するか」です。

そして最終的にはここに行き着きます。AIの出力がおかしいかどうかを判断できるのは、その分野の知識を持つ人間だけです。「この数字はあり得ない」「この解釈は現場感覚とズレている」という直感は、実務経験に裏打ちされた最後の砦です。

AIを使いこなせるマーケターとそうでないマーケターの差は、ツールの習熟度ではなく、このドメイン知識の深さにあると私は確信しています。

あなたは今、何を解きたいですか?

最後に一つ、問いかけをさせてください。

今あなたがAIに投げている質問は、目標と理想状態を踏まえた上での問いですか?それとも、何となく「いい感じの答え」を求めていますか?

AIは強力なツールです。しかし、使い手の思考が曖昧なまま使えば、曖昧な答えが返ってくるだけです。逆に言えば、思考の設計がしっかりしていれば、AIは思考の幅を劇的に広げてくれます。

「AIに何を聞くか」より「自分が何を解きたいのか」を先に決める。この順番を守るだけで、AIとの付き合い方は大きく変わります。

まとめ

- AIの答えがズレる根本原因は、目標・理想状態が設定されないまま質問していることにある

- AIは「汎用解」しか出せない。自分たちの文脈に照らして判断するのは人間の役割

- 思考の順番は「目標設定→問題整理→課題設定→仮説→アクション設計」。AIはこのプロセスを補助するツール

- 問題整理の壁打ちにはAIが有効。ただし「答えを出させる」のではなく「問いを返させる」使い方が正解

- 課題設定と仮説の絞り込みは人間が主導する。ここを飛ばして答えだけ持ってくるから「??」が起きる

- AIの正確性は「担保」するものではなく「設計」するもの

- 最後の砦は、ドメイン知識に裏打ちされた人間の判断力

参考:Black-box AI: Does your AI analytics tool show its work? | Mixpanel Blog(2026年2月) https://mixpanel.com/blog/black-box-ai-analytics/

コメント